今日焦點(Top Headlines)

中美 AI 同步加速與高頻模型迭代觀察

核心摘要

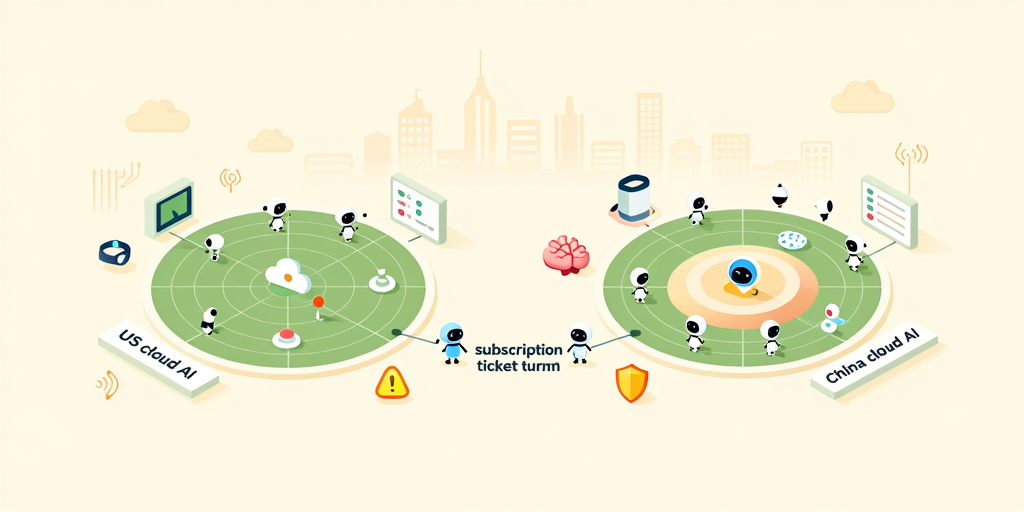

報導統計,2026 年初中美在大模型迭代節奏上幾乎同步:中國陣營在 47 天內出現 30 次「具行業影響力」的模型技術更新,平均約每 1.5 天一次;美國則以 Meta 的 Llama4 Swarm、Google 的 Gemini 3.1 Pro 等為代表,持續推出新版本。多個全球權威榜單上,中美模型各有勝負,而中國模型在開發者社群與應用市場中正獲得越來越多海外用戶採用與「投票」,顯示技術與生態雙向競爭態勢趨於白熱化。

技術細節

- 代表性模型:Meta Llama4 Swarm、Google Gemini 3.1 Pro 被點名為近期技術節奏標誌。

- 節奏指標:中國在 47 天內出現 30 次「具行業影響力」的模型或技術迭代,反映從基座模型到行業模型的高頻更新。

- 評估維度:多個「全球權威榜單」上,中美模型在不同榜單與指標上互有優勢,沒有單一絕對領先者。

- 生態信號:中國模型在開發者社群(API/SDK 採用)與應用市場(產品落地)中,海外用戶的選擇與正向回饋明顯增加。

應用場景

- 企業與開發團隊在選型時,實際可在中美兩套生態中多源頭選擇,依據成本、性能與合規要求動態切換。

- 頻繁迭代意味著 API 能力、價格與穩定性在短期內可能反覆變動,對需要長週期穩定運行的企業產品帶來架構與供應風險管理需求。

- 海外開發者開始將部分中國模型納入模型組合(ensemble)或 A/B 測試,尋求在特定任務上的性價比優勢。

關鍵實體:Meta、Llama4 Swarm、Google、Gemini 3.1 Pro、量子位、中國大模型生態

重要性:高

來源: 量子位報導

阿里雲 Coding Plan:多模型訂閱與請求定價

核心摘要

阿里雲宣布其 Coding Plan 訂閱服務新增支援四款編程型大模型:Qwen3.5-Plus、Qwen3-Coder-Next、GLM-4.7、Kimi-K2.5,用戶在不變更訂閱與配置的情況下即可自由切換。對新用戶提供首購 2 折優惠,首月 18,000 次請求僅需 7.9 元人民幣、90,000 次請求 39.9 元。報導同時指出,AI Agent 作為大模型主要應用載體,其多輪規劃與工具調用會使 Tokens 與算力消耗急劇上升,成本結構與傳統 Chatbot 明顯不同。

技術細節

- 模型組合:

- Qwen3.5-Plus(通用增強)、Qwen3-Coder-Next(編程專向)、GLM-4.7、Kimi-K2.5。

- 訂閱能力:

- 同一 Coding Plan 下可在上述模型間自由切換,避免重新配置專案或計費方案。

- 成本與配額:

- 首購 2 折示例:

- 18,000 次請求 ≈ 7.9 元人民幣

- 90,000 次請求 ≈ 39.9 元人民幣

- 首購 2 折示例:

- Agent 成本特性:

- 報導強調:多輪規劃+多工具調用的 Agent 其 Tokens/算力消耗遠高於單輪對話 Chatbot(原文指出單個 Agent 算力消耗可能是傳統 Chatbot 的數十到百倍量級,具體數值在來源截斷)。

應用場景

- 雲端 IDE / Code Assistant:直接調用 Qwen/GLM/Kimi 等編程模型,支援補全、重構、單元測試生成等。

- 多代理工作流:在一個訂閱下試驗不同模型組合(如用 Qwen3-Coder-Next 做編碼、GLM-4.7 做解釋),以尋找最佳成本/效果比。

- 成本敏感型團隊可利用低價高配額方案,先行大規模試驗 Agent 工作流與自動化 pipeline,在收斂之前控制成本上限。

關鍵實體:阿里雲 Coding Plan、Qwen3.5-Plus、Qwen3-Coder-Next、GLM-4.7、Kimi-K2.5、AI Agent、量子位

重要性:高

來源: 量子位報導

中國腦機介面產業加速從研發到商用

核心摘要

報導指出,中國腦機介面(BCI)產業正快速從學術研究與實驗室階段走向商業化。驅動因素包括:中央與地方政策強力支持、臨床試驗規模明顯擴大,以及資本市場對 BCI 領域關注度上升。研發、臨床驗證與產業化在時間軸上呈現同步推進的態勢,顯示中國試圖在下一代人機交互與神經技術上構建完整產業鏈。

應用場景

- 臨床與康復場景:透過擴大臨床試驗,將 BCI 技術從動物實驗與小規模人體研究推向更大樣本的臨床驗證。

- 工業與商業產品:政策與投資支持下,企業加速探索醫療器械、輔助溝通裝置或新型交互設備等方向的商業化路徑。

- 生態層面:科研機構、醫院、硬體與演算法公司在同一場域內協同,推動從基礎研究到應用轉化的閉環。

關鍵實體:腦機介面(BCI)、臨床試驗、政策支持、投資者、中國

重要性:中

來源: TechCrunch 報導

模型與技術更新(Model & Research Updates)

LLM 非參數交易代理與情節記憶(HashTrade)

核心摘要

HashTrade 是一個開源自主交易代理,將大型語言模型(LLM)視為「以情節記憶為條件的非參數決策函數」,不再用 if/else 等硬編碼規則描述交易策略。系統向 LLM 暴露三種工具:交易所存取、記憶體與 UI 控制,讓代理在累積交互與市場經驗的過程中逐步形成策略並執行實際交易。

技術細節

- 決策範式:

- LLM 被視為黑箱決策函數,輸入包括當前市場狀態與從「情節記憶」檢索出的過往經驗;輸出為操作建議(如下單、調整倉位、觀望等),而非由開發者編寫固定規則。

- 工具化設計:向 LLM 暴露三類工具介面:

- 交易所存取(exchange access):查詢報價、提交訂單、查詢倉位等。

- 記憶(memory):記錄與檢索過往交易決策與結果,構成情節記憶。

- UI 控制(UI control):對前端 UI 或交互界面進行操作,以便觀察或指令執行。

- 情節記憶(episodic memory):

- 系統將每次交互與市場反饋存入記憶,後續再將相關片段作為上下文提供給 LLM,形成「條件化在歷史經驗之上」的決策。

- 開源實作:

- 專案託管於 GitHub

mertozbas/hashtrade,提供完整程式碼便於審閱與二次開發(來源未提供具體語言與框架細節)。

- 專案託管於 GitHub

應用場景

- 自主交易/量化原型系統:快速搭建從行情感知、決策到下單的端到端實驗系統,用於驗證「LLM+工具+記憶」在金融場景的可行性。

- 代理研究平台:作為研究 LLM 代理在高風險、高延遲回饋環境(如金融市場)中行為模式與風險管理機制的開源試驗田。

- 教學與 PoC:為對金融 AI 與代理架構感興趣的團隊提供一個可直接運行與修改的示例工程。

關鍵實體:HashTrade、LLM、情節記憶(episodic memory)、非參數決策函數、GitHub(mertozbas/hashtrade)、自主交易代理

重要性:高

來源: [Show HN 描述](Hacker News: Show HN: HashTrade – Open-source LLM trading agent with episodic memory) | GitHub 專案

離線即時程式碼架構理解引擎(無 LLM / 無訓練資料 / 無雲)

核心摘要

一項在 Hacker News 上分享的技術聲稱,可在本地筆電上對任意語言、任意規模的程式碼庫進行分析,在不到一秒內輸出「實際架構」描述。輸出內容並非傳統的相依圖或檔案樹,而是指出哪些元件協調哪些元件、狀態存放位置、系統邊界以及潛在修改會破壞的部位。作者在 6 個真實專案(涵蓋 4 種語言、45,000+ 個函式)上測試,並強調整體不依賴雲端、GPU、LLM 或任何訓練資料。

技術細節

- 分析能力:

- 支援「任意語言」與大規模程式碼庫,仍能在次秒級輸出架構理解結果。

- 結果聚焦於:協調關係(誰 orchestrates 誰)、狀態位置(state 存在何處)、系統邊界(boundaries)、與變更影響面(更動會破壞哪裡)。

- 執行環境:

- 於筆電執行,無需 GPU、雲端資源或外部推理服務。

- 不使用 LLM,也不依賴任何「訓練資料」,更接近高效程式分析引擎而非學習系統。

- 實證規模:

- 在 6 個實際專案上測試,涵蓋 4 種程式語言、超過 45,000 個函式。

- 來源未披露具體算法(如純靜態分析、動態分析或混合技術),亦未提供精度指標。

應用場景

- 快速架構摸底:對接手的新或遺留系統,開發者可在無需編譯或大量手動閱讀的情況下,快速獲得架構全景。

- 影響分析與風險評估:在大規模 refactor 或模組替換前,用於估算變更範圍與風險點。

- 安全與合規審查前置:在正式安全掃描前,先行鎖定關鍵狀態管理與邊界位置,縮小審查範圍。

- 本地隱私場景:由於不依賴雲端與 LLM,可適用於敏感代碼庫或受嚴格合規限制的環境。

關鍵實體:程式碼架構分析、LLM-free、無訓練資料、本地執行、45,000+ 函式、Hacker News

重要性:高

來源: Hacker News 討論

AutoFigure:上萬字輸入生成可編輯 SVG 的智能繪圖框架

核心摘要

西湖大學 AutoFigure 團隊在 ICLR 2026 提出 AutoFigure 框架,可一鍵讀取上萬字的論文、書籍或博客內容,自動生成高品質學術插圖,並輸出為可編輯的矢量 SVG。目標是消除現有生成式工具在「審美 vs 邏輯」與「生成 vs 後續編輯」之間的斷層,降低學術製圖的人力成本。

技術細節

- 框架定位:

- 以長文本為輸入(論文/書籍/博客),產出結構化的學術插圖。

- 強調生成結果兼顧內容邏輯與視覺審美。

- 輸出格式:

- 直接產出可編輯的 SVG 向量圖,而非位圖,方便在後續工具(如繪圖軟體、排版系統)中進行細緻調整。

- 研究背景:

- 收錄於 ICLR 2026,說明研究具一定學術審查與關注度。

- 來源未披露具體模型結構、訓練資料與實驗數據,但明確定位為「智能體繪圖框架」,暗示背後結合了文本理解與圖像生成模組。

應用場景

- 學術論文插圖:自動從論文中抽取實驗流程、模型架構、系統示意等,生成可直接用於投稿或簡報的圖表。

- 教學簡報與科普圖解:將長篇技術博客或書籍章節轉為結構化視覺材料,用於教學或科普。

- 團隊知識沉澱:對內部設計文檔進行視覺化,快速建立共享心智模型,降低溝通成本。

關鍵實體:AutoFigure、西湖大學、ICLR 2026、SVG、生成式 AI、量子位

重要性:中

來源: 量子位報導

工具與資源(Tools & Resources)

Windows 本地 LLM:Ollama 與 LM Studio (ThinkPad / RTX A3000)

核心摘要

GitHub 倉庫 gbro3n/local-ai 提供一份「Local LLM Setup on Windows with Ollama and LM Studio」文件,聚焦在 Windows(例如 ThinkPad+RTX A3000 GPU)環境下,以 Ollama 與 LM Studio 搭建本地大型語言模型的實作指引。該資源面向希望在本地硬體上運行 LLM 的開發者。

技術細節

- 平台與硬體:

- 作業系統:Windows

- 目標機型:ThinkPad + RTX A3000 GPU(行動工作站級別)。

- 工具鏈:

- Ollama:常用於快速拉取與運行本地 LLM 的管理工具。

- LM Studio:支援在本地環境中管理、測試與調用多種 LLM 的桌面應用。

- 文件內容(根據標題與路徑):

- 位於

docs/local-llm-setup-windows-ollama-lm-studio.md,預期包含安裝步驟、環境依賴與基本測試流程(具體細節需讀原文)。

- 位於

應用場景

- 隱私敏感專案:在不將數據上雲的情況下,於本地完成原型設計與內部工具開發。

- 模型評測與比較:在單一 Windows 工作站上快速切換與試驗不同本地模型。

- 教學與工作坊素材:作為教學示例,幫助開發者熟悉「從零到本地 LLM」的搭建流程。

關鍵實體:Ollama、LM Studio、Windows、ThinkPad、RTX A3000、GitHub(gbro3n/local-ai)、Hacker News

重要性:中

來源: GitHub 文件 | Hacker News 討論

ScreenCommander:讓 LLM 代理透過 CLI 控制桌面

核心摘要

開源專案 ScreenCommander(Show HN)旨在讓 LLM 代理透過命令列介面(CLI)控制使用者桌面。專案託管於 GitHub,HN 貼文將其標註為 LLM 類別,定位在「CLI 介面下由 LLM 代理驅動桌面操作」的自動化工具。

技術細節

- 專案資訊:

- 名稱:ScreenCommander

- 託管:GitHub

0xSMW/screencommander - 分類:Hacker News Show HN(LLM 標籤)

- 功能輪廓:

- LLM 代理在 CLI 環境下接收高階指令,並將其轉譯為桌面層級操作(例如打開應用、操控視窗、執行任務等)。

- 提供從文字指令到 GUI 動作的橋接能力(具體 API 與安全機制需參考原始程式碼,來源未給出細節)。

應用場景

- 桌面自動化:讓代理替代傳統腳本,自動完成多步驟的 GUI 任務,例如批次處理檔案、操作專用客戶端等。

- 無頭工作流編排:透過 CLI 與遠端桌面結合,構建 headless 但 GUI 感知的自動化流程。

- Agent 研究:作為研究「LLM 代理如何安全地控制實體系統」的原型專案,關注權限控制與誤操作風險。

關鍵實體:ScreenCommander、LLM Agents、CLI、桌面自動化、GitHub、Hacker News

重要性:中

來源: GitHub 專案 | Show HN 貼文

從零到 LLM Agent 教學:Agent 自寫迴圈

核心摘要

「Zero to LLM Agent」教學系列的第六篇記錄了一個最小化 LLM Agent(使用 GPT4.1),在已有與 OpenAI LLM 溝通程式碼與單一工具(Python REPL)前提下,成功「自動生成」了自己的 Agent Loop 函數。作者在前幾篇中已完成與 OpenAI LLM 的程式化互動,只給予 Agent 一個工具:互動式 Python 環境(使用 ipython)。

技術細節

- 模型與介面:

- 使用 GPT4.1 作為核心 LLM,透過 OpenAI 提供的 API/介面進行調用。

- 最小 Agent 設定:

- 工具:唯一工具為 Python REPL(以 ipython 提供互動環境)。

- 能力邊界:Agent 只能透過此 REPL 執行 Python 程式碼。

- Agent Loop 自生成:

- 在足夠的上下文提示下,LLM 生成了控制自身行為的 Agent Loop 函數,即以程式碼形式實作「感知-思考-行動」迴圈。

- 展示了利用 LLM 生成 Agent 控制邏輯本身的可能性,而非僅生成業務程式碼。

應用場景

- 教學與訓練:為開發者提供由淺入深構建 LLM Agent 的範例,特別是「如何用最少工具支援讓 Agent 自我擴展」。

- 原型實驗:從此最小範例出發,逐步增加工具(例如檔案系統、網路請求)觀察 Agent 行為變化。

- Agent 工程研究:探索由 LLM 主導產生 agent loop 的優劣,對比由人類工程師手寫控制迴圈的安全性與可控性。

關鍵實體:GPT4.1、OpenAI LLM、Python REPL、ipython、Agent Loop、Zero to LLM Agent

重要性:中

來源: 教學系列文章

產業與應用動態(Industry Applications)

Palantir 提供之 AI 工具於大都會警察局行為監測

核心摘要

英國大都會警察局(Met / Scotland Yard)被披露使用由美國技術公司 Palantir 提供的 AI 工具,對員工(警員)行為進行監測與分析,以標記可能失職或表現不佳的人員。警方工會將此批評為「自動化懷疑」(automated suspicion),而 Met 對是否使用該技術拒絕證實或否認,引發對透明度與問責的質疑。

應用場景

- 內控與紀律監測:透過行為數據與紀錄,篩檢出潛在高風險或表現異常的警員,用於內部審查或培訓干預。

- 風險管理儀表板:將個人與部門級別的風險指標可視化,供管理層進行資源配置與風險預警。

- 爭議點:在警務與勞動場域,引入第三方 AI 供應商的黑箱系統,易引起偏見、公平性與冤假錯案風險的討論。

關鍵實體:Palantir、大都會警察局(Met)、Police Federation、員工行為監測、AI 工具

重要性:中

來源: The Guardian 報導

學校採用聊天機器人審查學生作業

核心摘要

部分澳洲學校已在作業流程中導入 AI 聊天機器人功能「Thinking Mode」,學生繳交作業後,系統會透過聊天機器人向學生提問、進行互動式審查,以判斷作品是否出自學生本人。獨立學校組織警告,技術快速部署可能導致教育體系出現「兩速系統」,教師整體對這波 AI 革命感到憂慮。

應用場景

- 作業真實性驗證:透過追問與互動來檢查學生對作業內容的理解深度,抑制純粹依賴生成式 AI 代寫。

- 教學輔助:在審查過程中由聊天機器人提供提示或糾錯,兼具評量與教學功能。

- 教育不平等風險:技術採用速度與資源差異,可能讓部分學校與學生享有更完整的 AI 支援與防弊機制,進一步拉大差距。

關鍵實體:Thinking Mode、AI 聊天機器人、Independent Schools Australia、澳洲學校、The Guardian

重要性:中

來源: 相關報導

產業趨勢與觀點(Industry Trends & Insights)

Vibe Coding 與 AI 代理的安全負債危機

核心摘要

文章指出,以「vibe coding」(速度與感覺優先、缺乏嚴謹設計)為導向的開發實務,在結合 AI 代理(AI agents)時會急速累積安全負債。當團隊過度追求開發速度與自動化程度,而忽略威脅建模、權限管理、輸入驗證等基本安全節點時,應用會在不知不覺間暴露於各類漏洞與攻擊面,最終成本遠高於前期投入的安全工程。

關鍵實體:Vibe Coding、AI Agents、安全負債、Towards Data Science

重要性:中

來源: 分析文章

創作者經濟面對大量 AI 生成內容的挑戰

核心摘要

TechCrunch 的 Equity 節目討論,在充斥低質 AI 生成內容(AI slop)的環境下,新一代創作者是否仍有機會突圍。對談聚焦於:演算法平台充滿大量機械化內容、觀眾注意力被稀釋後,靠「人味」與差異化創作是否足以維持成長;節目並未涉及具體技術實作,而是從產業與生態角度審視創作者經濟的未來。

關鍵實體:TechCrunch、Equity 播客、創作者經濟、AI slop

重要性:中

來源: TechCrunch 報導

聊天機器人過度依賴對思維影響與工作流程

核心摘要

報導描述一位患有 ADHD 的 44 歲男性,在經營事業與處理行政瑣事時大量依賴 ChatGPT 與各類聊天機器人,AI 已深度改變其工作流程。然而專欄作者憂慮,這種高度依賴正在削弱其獨立思考與決策能力,並指出「過度依賴聊天機器人」已成為日益普遍的現象,亟需從焦慮根源與心理健康角度重新審視人機互動關係。

關鍵實體:ChatGPT、聊天機器人、ADHD、心理健康、The Guardian

重要性:中

來源: The Guardian 專欄

市場動態精選(Key Market Updates)

雙倍規模基金反映量子技術投資信心

核心摘要

專注量子與物理基礎創業公司的風投 Quantonation Ventures 宣布完成第二支基金募資,規模達 2.2 億歐元(約 2.6 億美元),為首支基金的兩倍且屬超額認購。報導認為,這顯示儘管市場上存在「量子寒冬」的討論,仍有足夠資本對量子技術中長期前景保持信心。

關鍵實體:Quantonation Ventures、量子技術、physics-based startups、TechCrunch

重要性:中

來源: TechCrunch 報導

歐盟與其他地區的替代 iPhone 應用商店

核心摘要

因應監管與市場壓力,Apple 在歐盟等地區開放 iPhone 用戶使用替代應用商店。TechCrunch 彙整了目前在歐盟及其他可用地區的替代 App Store 清單,說明不同商店的可用範圍與基本特性。儘管報導未深入技術實作層面,對開發者與服務商的分發策略具有直接市場影響。

關鍵實體:Apple、iPhone、替代應用商店、EU、TechCrunch

重要性:中

來源: TechCrunch 彙整

TechCrunch Disrupt 2026 早鳥票價截止倒數

核心摘要

TechCrunch 宣布 Disrupt 2026 的 Super Early Bird 最低票價將於 2026-02-27 23:59(太平洋時間)截止。自 2 月 22 日起讀者仍有 6 天可享最高約 680 美元的票價折扣。此類大型創業與技術大會仍是 AI 創業公司與投資人關鍵交流場域。

關鍵實體:TechCrunch Disrupt 2026、Super Early Bird、門票優惠

重要性:低

來源: TechCrunch 公告

編輯洞察(Editor’s Insight)

今日趨勢總結

2026 年開年,中美在大模型迭代節奏上的同步加速,配合中國雲廠商與 BCI 產業的積極商業化,顯示 AI 技術競賽已從單點模型性能轉向「生態與應用密度」的較量。一邊是 Llama4 Swarm、Gemini 3.1 Pro 等國際模型頻繁更新,一邊是中國在 47 天內完成 30 次重要迭代,加上海外開發者對中國模型的採用,全球算力與模型供應版圖正變得更加多極化。

與此同時,產業界對 Agent 化與自動化的下注愈發明顯:阿里雲以多模型 Coding Plan 降低開發者試錯成本,ScreenCommander、HashTrade、Zero-to-Agent 等專案則從桌面自動化、金融交易到自生 Agent Loop,持續推高「LLM + 工具 + 記憶」的工程實驗溫度。反面則是安全與治理壓力的同步增加:警務監測、教育評量、個人過度依賴聊天機器人,以及「vibe coding」帶來的安全負債,都在提醒產業這場加速並非零風險。

技術發展脈絡

技術層面上,本日最值得關注的是「工具化 LLM 代理」的多樣化路徑。HashTrade 將 LLM 視為以情節記憶條件化的非參數決策函數,透過交易所存取、記憶體與 UI 控制三個工具讓代理在實戰中「長出」策略;Zero-to-Agent 則以 GPT4.1+Python REPL 的極簡配置,實證 LLM 能直接生成自身的 Agent Loop。這些實作共同指向一個方向:未來代理系統的關鍵不只在於模型,而是在於「工具接口設計+記憶結構+控制迴圈」。

另一方面,離線即時程式碼架構分析引擎與 AutoFigure 代表了「非 LLM 或弱 LLM」思路下的高價值輔助工具:前者在本地、無訓練資料的前提下提供跨語言架構理解,後者將長文本轉為可編輯 SVG 學術插圖。搭配本地 LLM 搭建指引(Ollama + LM Studio),可以看到一條清晰脈絡:在雲端大模型之外,本地與專用分析工具正在構成第二條技術路徑,為成本、隱私與性能優化提供更多選項。

未來展望

短期內,AI Agent 將沿著「更多工具、更長記憶、更高自治」的方向持續實驗,同時迫使雲服務商與開發團隊正視成本曲線:阿里雲 Coding Plan 類型的多模型訂閱與高配額低門檻方案,將成為觀察 Agent 經濟性的關鍵窗口。誰能在性能、成本與安全之間找到新的平衡點,誰就更有機會在這一輪代理競賽中取得領先。

中長期看,警務與教育場景中 AI 的部署,以及個人對聊天機器人的心理與行為依賴,會倒逼監管與治理框架更快成形。對技術決策者而言,現在就應在系統設計中預留審計、可解釋與「人類最終決策」的介面,避免在監管收緊後被迫大幅重構。與此同時,量子與 BCI 等前沿硬科技在資本與政策支持下持續升溫,也將逐步與當前的 AI 生態產生交集,開啟新的跨領域協同機會。

關注清單:

- HashTrade 等開源交易代理在真實市場環境中的穩定性與風險控制實踐。

- 阿里雲 Coding Plan 多模型方案在大規模 Agent 工作流下的實際成本曲線與用戶留存。

- 無 LLM 程式碼架構分析引擎是否開源或商品化,以及其與 LLM-based Code Assistant 的互補關係。

- 中國 BCI 產業臨床試驗結果與首批商用產品形態,及其與現有醫療器械生態的整合。

- 教育與警務領域 AI 監測工具的政策演變,包括透明度要求與審計義務的新規。

延伸閱讀與資源

深度文章推薦

- The reality of vibe coding, AI agents, and the security debt crisis — 系統性討論「速度優先」開發文化在 Agent 化時代帶來的安全負債,適合作為安全架構設計的反思讀物。

- Zero to LLM Agent — 從最小可行實作出發的 Agent 教學系列,可幫助工程師從實戰角度理解 agent loop、工具使用與與 LLM 的程序化互動。

- 中美 AI 高頻迭代引發的產業觀察 — 以數據梳理中美雙方在模型迭代頻率、榜單表現與開發者採用上的最新態勢,適合作為戰略背景閱讀。

相關技術背景

- LLM 代理(LLM Agents):以大型語言模型為決策核心,結合工具調用、記憶與控制迴圈,執行多步驟任務的系統形態。

- 情節記憶(Episodic Memory):在代理系統中,以可檢索的方式存儲過往交互與決策,供未來決策時作為條件上下文。

- 本地 LLM(Local LLM):在個人或企業自有硬體上部署並運行的大型語言模型,相對雲端 API 更強調隱私、可控成本與離線可用性。

- 腦機介面(Brain-Computer Interface, BCI):直接在神經系統與外部設備之間建立通訊通道的技術,應用涵蓋醫療康復、新型交互等。

- 矢量圖形 SVG:一種基於 XML 的可縮放向量圖形格式,適合用於需要後續編輯與高品質排版的學術與工程插圖。

- 安全負債(Security Debt):類似技術負債,指在系統設計與實作中暫時忽略安全考量所累積的隱性風險與未來改造成本。

本日關鍵詞

LLM 代理 情節記憶 本地 LLM AI Agent 成本 腦機介面 BCI 程式碼架構分析 學術插圖自動化 安全負債 AI 在警務監測 AI 在教育評量 多模型訂閱 量子投資基金

資料來源:29 篇文章 | 分析主題:28 個

資料收集時間:過去 24 小時 | 報告生成時間:2026/02/23 06:42:07 CST